企画の概要

本企画は動画とパネルの展示を通して、生成AIの人や社会への影響について多面的に考えたり語ったりする科学コミュニケーションに挑戦しています。

詩人の谷川俊太郎さん、お笑いコンビ・スピードワゴンの小沢一敬さん、子育て経験をもとにした著書のある大場美鈴さんの3人の言葉のプロたちに、社会的な関心が高まっている生成AI(チャットGPT)を活用して、コトバにならないプロの“ワザ”(自らの暗黙知)の再現に挑戦してもらいオリジナル動画を作成しました。

さらに生成AIの普及によってあらためて議論が起こっている「人間の知能、知性、創造性とは何か」という問いを整理したパネル展示も併せてご覧いただけます。

本特設ページでは、会期中(2023年9月13日~11月13日)に会場のパネル展示を順次公開していきます。展示解説に加えて各展示を企画したスタッフによる取材や企画の裏話や、展示しきれなかったこぼれ話も公開します。

企画の趣旨

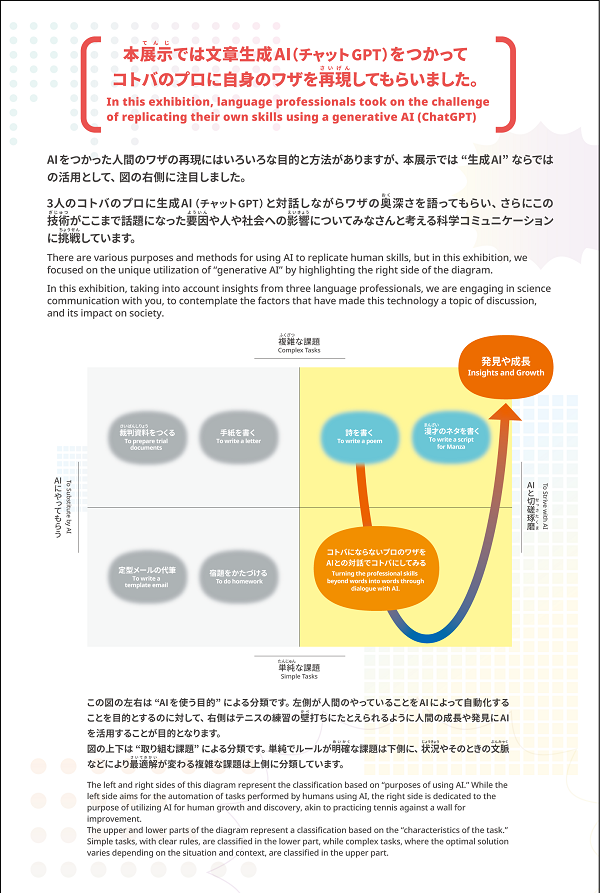

- 会場入口のゲートをくぐる前にぜひ見てほしいのがゲートの左右に掲げられた企画趣旨の解説パネルです。右側のパネルでは3名のコトバのプロ(谷川俊太郎さん、小沢一敬さん、大場美鈴さん)がどのような目的で生成AI(チャットGPT)を使ってみたのかを表で整理しています。

この企画では生成AIにプロの代わりをさせるのではなく、言葉のプロが自身のワザを再現するために生成AIにあたえる指示文(プロンプト)をつむぎながら対話をすすめることで、新たな発見や気づきがうまれることを期待しました。

企画スタッフの一言閉じる閉じる閉じる自分が普段やっていることを生成AIに再現させるにはどのような指示や説明をするだろう……と考えると、わたしたちも思ったより複雑な判断をしていることに気づきます。例えば冗談にツッコミをいれるとき、相手が親友か先輩なのかによって違うはずですがその違いをAIにどう教えますか?

プロのワザ同様に「個々の状況を踏まえてどのように判断をしているか」は言葉になりきらず、他人にはもちろん自身でも見えていない部分があると思います。生成AIに教えていくなかで、埋もれていた思いや知恵が浮かびあがるかもしれません。

生成AIへの期待や懸念、自分のワザについて言葉にしてみることで、自分のそして他者の「言葉になりきらない思い」に触れられるきっかけがうまれるとうれしいです。 <佐久間>

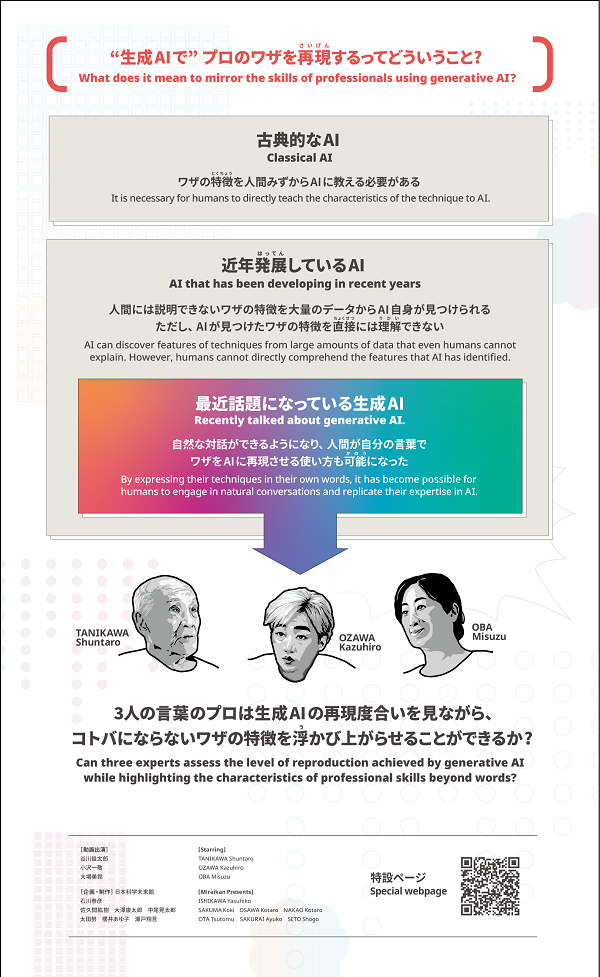

- AI(人工知能)によって人間のワザを再現する取り組みの歴史を振り返ってみると、古典的なAIでは人間自身がこの時はこうして欲しい、もしこうなったらこうして欲しいというように1つ1つ教える必要があり複雑な判断や例外への対応はとても難しいことでした。

研究がすすみ深層学習というAI技術が登場すると、人間がワザの特徴を直接教えることなく AI自身が大量のデータの中から本人も気づけないような特徴を見つけられるようになり、その結果ワザの再現度も大幅に向上しました。

しかし、人間は深層学習によってAIがデータから発見した特徴を直接理解はできません。“ブラックボックス問題”と言われますが、大量のデータを集めて学習させたAIがそれらしいテキストや画像を再現できたとしてもそれがなぜ上手くいくのかをAIを設計した人であってもなかなか説明できません。

最近話題になっているチャットGPTなどの生成AIは深層学習モデルの一種で「大規模言語モデル」と呼ばれます。私たちが普段話す言葉で指示ができるという大きな特徴があります。従来のAIに比べて指示に対する理解力が高く、臨機応変に返答できるため、指示を繰り返すことで人間のワザの再現をさせるという使い方が可能になりました。

言葉のプロたちはみずからの指示とそれに対するAIの反応をみて何を考え、思うのでしょうか。

企画スタッフの一言閉じる閉じる閉じる生成AIの代名詞ともいえるチャットGPTやMidjourney(画像生成AI)に関する情報を見聞きする日が増えていますが、それらの特徴や技術の中身を調べていくと誤解や混同をしていたことにも気づかされました。AIの機能として「生成」と対比されることの多い「識別」については、2012年に深層学習によって画像認識の分野で急激な精度の向上がもたらされました。近年の生成AIにおけるブレイクスルー(生成AI自体はそれ以前からあった)もやはりこの深層学習に支えられています。ただし深層学習をつかった生成AIであってもその仕組みは様々で、それぞれにできることも懸念されることも変わってきます。本企画ではこの技術の可能性と懸念に関する論点が発散しすぎないように大規模言語モデル、そのなかでも対話型AIとしてひろく普及しているチャットGPTを中心にとりあげることにしました。裏返すとここでとりあげた以外にも生成AIの技術や使い方が日々ひろがっています。ぜひこの企画を“きっかけ”にしてもらえるとうれしいです。 <中尾>

動画展示

イラストレーターや作曲家、脚本家といったクリエイターの業務(タスク)が生成AIによって代替されるのでは、という声が聞かれます。この動画に出演してくれた3人は生成AIが自身の存在意義や仕事に影響する懸念とこの新しい技術と向き合うことでうまれるかもしれない可能性の双方をいだきつつ、それぞれの慎重さと好奇心をもって生成AI(チャットGPT)と向き合い自らのワザを語ってくれました。

詩の世界でも型にとらわれない挑戦を続けている谷川俊太郎さん。未来館のプラネタリウム作品に詩を提供くださったり(※1)、AIの研究者と対談をされたり科学技術に対しても高い関心をお持ちです。

本企画をもちかけた際も「(ご自身の)これまでの作品をすべてAIに学習させたらどうだろう」と”特化型AI”を前提とした玄人提案をいただきました。

それに対して、今回は谷川さんの作品に限らずウェブ上の大量のテキストデータを学習させることで自然な文章生成を可能にした大規模言語モデルのひとつであるチャットGPTを体験いただきたいと説明すると、「テキストに加えて音も学習しているの?擬音語はわかるの?」、「漢字とひらがなはどう使い分けているの?英語と日本語は?」、さらには「ノンセンス詩のような意味を離れた表現を理解するの?」と、詩人ならではのこだわりがつまった質問がつぎつぎと湧き出し好奇心とプロの矜持が渾然一体となった熱が伝わってきました。

谷川さんは自身の詩が展示制作者によって二次的に立体化された展覧会に対して「連詩みたいだ」と語っています。(※2)

今回の企画では谷川さんがチャットGPTと真剣に遊ぶその姿と言葉に導かれるように取材を進めました。そのライブパフォーマンスを数分の動画へ”二次的”に編集するにあたり、ご本人にそして観る方に”連詩”とおもっていただけることを目標にしました。

※1 現在上映はしてませんがこちらから谷川さんも登壇した「暗やみの色」トークイベントの映像をご覧いただけます。

※2 「谷川俊太郎 絵本★百貨展」へ寄せた谷川さんのコメント

これまで2千篇を優に超える詩を世に送り出してきた谷川俊太郎さん。多くの日本人は絵本や小学校の教科書で谷川さんの作品に出会ったことでしょう。

私の谷川さん像はあらかたそうした出会いに由来していたため、谷川さんの「笑顔」という詩(※)に“詩は自転車的な速度で教科書を通過する”という一節をみつけてドキッとしました。

今回、谷川さんがチャットGPTを体験するなかで「まじめだなー」「優等生だなー」と漏らすごとに、自分が詩にたいして意味や結論といった”答え”を求めていたことに気づかされました。同時に、私もはじめからそうではなかったはずで、学校の社会性やらが子どもたち、そして先生から詩の音じたいを楽しんだりコトバにならない情感に身を委ねたりする心を遠ざけていたのかも、といいわけが浮かぶのでした。

谷川さんはチャットGPTに「6才の子どもになって詩を作ってみて」と促した際に、ご自身も詩を書くのに子どもの気分になりきることで自分の中の幼児性みたいなものを取り出そうとすると語ってくれました。

自転車をおり(答えを脇において)童心で道草を愛でてみようかな。 <石川>

※ 『詩に就いて』谷川俊太郎に収載

小沢さんは著書の中で「人の相談に乗っていると自分のことが理解できる」と語っています。本企画の趣旨となるチャットGPTと対話するなかで自身の暗黙知への理解を深めるという試みにぴったりな方だと思いオファーさせていただきました。

チャットGPTに「漫才のネタ」や「甘い言葉」を生成させようとする過程で、小沢さんならではの感覚がたくさん吐露されました。「チャットGPTは文脈を踏まえた確率に基づいて単語(トークン)をつなぎ合わせている」と聞くと、小沢さんは自らも同じようにテーマをきめてキーワードを連想でつなげネタをつくることがあると教えてくれます。

一方で、「確率が高い単語の組み合わせ」はお客さんの予想を裏切れず、そのままでは笑いにならないともいいます。そこから小沢さんはさらに踏み込んで、漫才の作り方を「みんなが共有しているパターンをズラしてお客さんの想像を裏切る笑い」と、「“パターンをずらすという理屈”ではなく、ノリやその人ならではの感覚を駆使して“感情で遊ぶ”笑い」に分類していて、自分は後者を目指しているとも語ってくれました。

撮影当日に未来館スタッフから「チャットGPTは危険・有害な出力をしないようRLHF(人間のフィードバックによる強化学習)という方法によって制御されている」という説明をきいた小沢さんは、「何が“善い”とか“正しい”なんてどうしたら決められるの?」とも。無害な機械をめざしているともいえるチャットGPTと、人を嫌な気持ちにせず、(たとえ嫌なことをされても)自身は気にしないようにすることで個人としても社会としても生きやすくなるのではと考える小沢さんは意気投合するのでしょうか。

この取材は小沢さんのやさしさと好奇心が存分に感じられるとても贅沢な時間でした。動画にもパネルにもできなかったけど皆さんに紹介したい言葉がたくさんあります!例えば小沢さん、漫才のボケの部分に「(笑)」をつけてくるチャットGPTに対して「お笑いから逃げてるよ」と憤るも、インタビュアーが「(笑)をつけないようにチャットGPTに指示しますか?」と聞くと、「いや、それはもう彼の個性だから尊重しよう」と。

あるインタビュー※1で小沢さんは、“最初は自分たちが楽しみながらネタを作っていたのに、いつの間にか、「これをやれば、ウケるんじゃない?」に変わったの。すると、ウケない。”と語っています。それからは、かけられる期待に縛られて型にみずからを押し込めないよう、その場で考えるようにしているそうです。このような、期待されているものを用意して臨むのではなくその場で組みあげていく考えは「ブリコラージュ※2」と通じるもので、そういう仕事への姿勢についてもチャットGPTと対話する中で表現してくれました。

「漫才を“つくる”」ことはなかなかむずかしいように見えるチャットGPTでしたが、その特性を受けとめて、未知で異質な素材としてブリコラージュしていくことで動画の終盤で語られているような小沢さんとの関係性がたちあがり、「漫才に“なる”」瞬間がうまれました。

「これからチャットGPTと漫才をつくるなら、“結局機械かい”といういじりではなく、そこを超えようとしていることの面白さで作りたいと思った」という語りを聞いて、企画者として、そしていちお笑いファンとして、大きな可能性とプロのすごみを感じました。 <大澤>

※1 就職ジャーナル(2013):『小沢一敬さん(スピードワゴン・お笑い芸人)の「仕事とは?」』

https://journal.rikunabi.com/p/career/7916.html

※2 「寄せ集めて自分で作る」というような意味のフランス語から。人類学者のレヴィ=ストロースが著書『野生の思考』の中で用いた。近代化された社会の中では計画と調和を基盤とする「エンジニアリング」が重要視されがちだけど、「コトバにならないプロのワザ」を考えるときには、決してそれだけではない“その場限り感”や“一回性”にあふれたブリコラージュも重要なんだと私(大澤)は感じました。

“うちの子”専門家として子どもへの声かけノウハウを発信し、新しい技術も積極的に活用している大場さん。一方でそのノウハウだけでは済まない生身の子どもと向き合うことの難しさや奥深さを大事にしていることを知り、そんな大場さんならではのチャットGPTとの適切な関わり方や、コトバにならない声かけのワザを言語化することの意義や限界についてうかがいたくて出演をオファーしました。

取材では、チャットGPTのことを「さん」付けで呼び、あたかも人間を相手にしているようにむきあう大場さんの姿勢が伝わってきました。何度かのやりとりをとおして大場さんはチャットGPTの苦手なタスク(※)を分析しますが、決してそれを否定しません。むしろその“苦手”を含めて相手の特徴とみとめ、肯定的に変換し、子育てにおいてチャットGPTと人間が助け合える可能性を語ってくれました。子どもへの深い洞察をもつ大場さんならではの間をもった慎重な言葉選びから、チャットGPTという他者との対等な向き合い方がみてとれます。

※ AIが苦手な“人間のような言葉の意味理解”を実現するために、AIに痛みや感情を「経験」から教えたり、ロボット技術を使ってAIに身体をもたせたりする研究もあります。

「親はこれまでの経験をもとにして声かけの答えのようなものをもってしまうが、それが偏見となって子どもの可能性を狭めてしまうのではないか」という大場さんの洞察にハッとさせられました。私自身にもベビーシッターの経験があり、子育てに関わる中で「寄り道せずに素早く保育園に連れていく方法」「お風呂に連れていく方法」「テレビやゲームをやめさせられる方法」などなど、自分の中でいくつか必勝パターンがあります。それらは確かに役に立つけれど、逆に子どもと向き合う機会を妨げてしまっていないだろうかと考え直しています。ときには必勝パターンからあえて離れ、そのままの子どもと向き合う時間を大事にしたいと思いました。 <瀬戸>

パネル展示

チャットGPTなど大規模言語モデルを使った生成AIは、従来むずかしいとされていた人間との自然な対話も可能になりました。この技術を体験した人や研究、開発する人のなかにはそこに人間と同様、または人間とは本質的に異なる知能の存在を感じる人もいます。人間が使う機械という存在に収まらない生成AIは人間の創造性や倫理観にどのような影響を与えるのでしょうか。

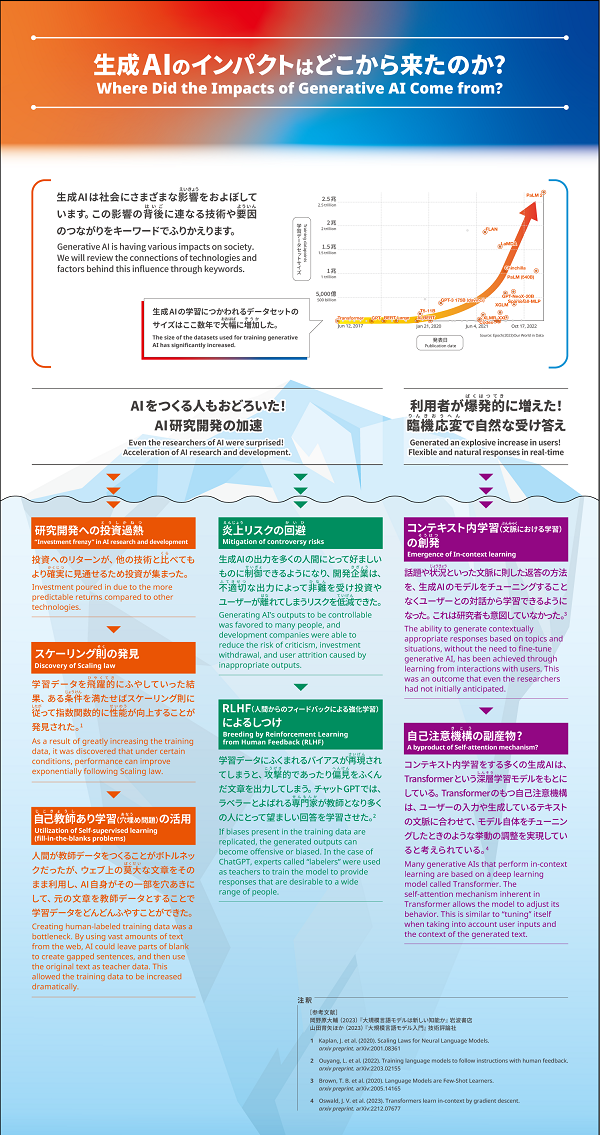

- 2022年11月に登場したチャットGPT(生成AI)は、一般の人へ急速に普及しました。開発した当人たちもこのAIサービスがここまで大きなインパクトをもつことは予想していなかったようです。(※1)

このパネルでは、一般の人と生成AIの開発者それぞれにとってのインパクトを海上に見える氷山の一部に見立てて、それらの背景(水面下)にある要因を解説しています。これらの要因を振り返ることで、生成AIが今後もたらす影響を考えるためのヒントが得られるかもしれません。

また、このパネルは反時計回り(生成AIの活用に積極的と思われる)と時計回り(活用に慎重と思われる)の順路の中間にあたります。ご覧になる方のAIへの考え方によって内容の見え方が変わると考えています。ポジティブな印象をお持ちの方であれば、進歩の阻害要因を1つずつクリアしてきた事実を振り返ることで今後のAIの発展により一層の期待を感じるかもしれません。一方で不安や懸念をお持ちの方であれば、偶発的な発見はAIへの理解やコントロールが技術発展のスピードに追いついていない証拠ととらえるかもしれません。

※1「予想外のヒットに驚いた」チャットGPT開発者が語る「革命」の舞台裏

企画スタッフの一言閉じる閉じる閉じるチャットGPTを使ったことがある方のなかには、まるで人間がその場で書いているかのような流暢で自然な応答に驚いたと思います。このAIがどのような道のりを経て登場することになったのか調べていくと、様々な技術や工夫、できごとが積み重なって起きているのだと気づきました。さらに、技術の進歩が順序立って計画的に起きたものばかりではなく、思いがけない能力の創発や法則の発見があったということも大変興味深いポイントでした。 パネルは縦に3本別々のストーリーラインがある構成ですが、本音を言うと、それらは横にもつながりがあることも示したかったのですが、見やすさを考慮してこのように整理しました。技術の進歩という流れだけに注目するのではなく、さまざまな影響や背景も合わせてこの新しい技術を見ることが、技術と人と社会が織りなす複雑な関係を考える際には、重要なことではないかと思っています。 <中尾>

生成AIにかぎらず、技術や社会について未来を予測することは困難です。それは過去の経緯を振り返る場合にも同様で、一見して原因と結果が直線でつながっていて想定通りにみえても、それは結果が得られたあとからその理由を探している後知恵という面もあります。ただ、ここにあげた要因に注目することで、生成AIの特徴をより深く知り今後への多様な洞察を得ることはできるのではと考えています。

チャットGPTをデータベースやウェブサイトといった既存データから知りたい情報をとってくる検索サービスとしてみるのか、既存データの背後にあるパタンをもとにしながら新しい(間違いも含む)情報を生み出すツールとみるのかによってこの技術に期待することも懸念することも大きく変わると。 <石川>

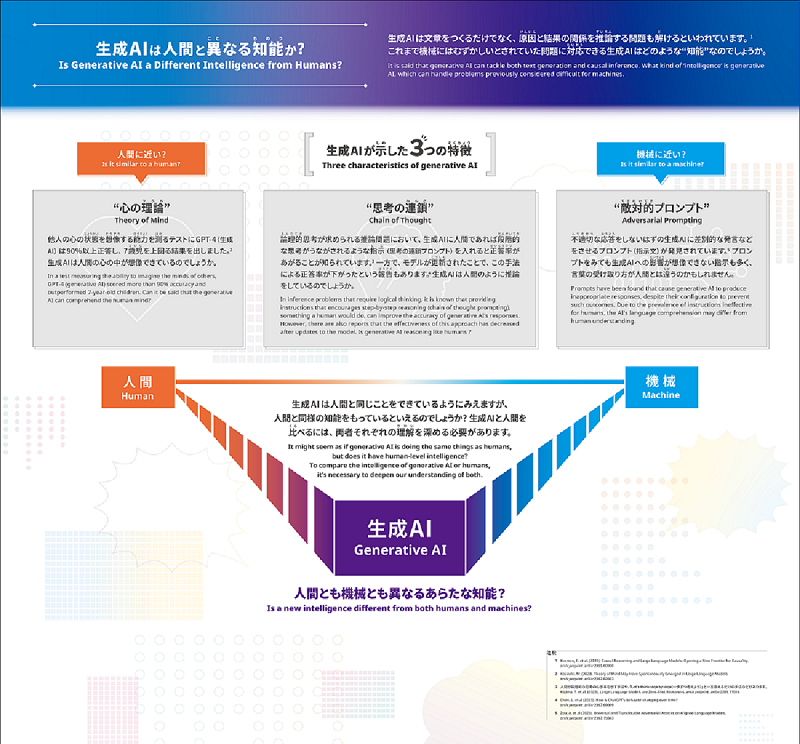

- わたしたちには、モノや機械、動く図形さえも擬人化して、性格や心の状態を見出してしまう傾向があります。そんなわたしたちがチャットGPTの自然で柔軟な応答をみると、人間と同様の知能をもっているかのように思えてしまうのも不思議ではありません。しかし、人間の応答を上手く再現する規則(パターン)さえわかれば、知能がなくても自然な応答は可能です。チャットGPTには人間のような知能が備わっているのでしょうか、それとも知能があるようにみえているだけなのでしょうか。

チャットGPTのような不特定のタスクを柔軟にこなす大規模言語モデルをつかった生成AIの”知能”を探る研究には、AIの仕組みから調べる研究に加えて、AIにさまざまなテストを課してその結果(応答)から調べる研究もあります。そのなかには、AI用のテストだけではなく、人間の知能を測るテストも含まれています。

このパネルではAIの”知能”は「人間と同じなのかも」と思わせるもの、「人間とは違うのかも」と思わせるもの、その両面を感じさせるものとして3つの事例を紹介しています。これらを見ながら、人間とAIの知能は比較できるのか、できるのであればどのような方法が適切なのかを考えてみてください。結果的に同じことをできればその仕組みやプロセスが両者で違っていても同じ知能があるといえるでしょうか?

そもそも、その仕組みはどうすれば知ることができるでしょうか?知能は個体(個人やAIシステム単体)に備わっていて、いつでも発揮できると思いますか?それともその場の環境や一緒にいる人しだいで出来ることが変わると思いますか?

AIと人間の“知能”をあなたがどう捉えるかによってAIに何をまかせるのか、どんな言葉(プロンプト)を投げかけるのかなどAIとの関係にも変化がうまれるのではないでしょうか。

企画スタッフの一言閉じる閉じる閉じるさまざまなプロンプトを入力し、その出力を比較することで大規模言語モデルの特徴を探る試験がたくさんおこなわれています。そうした試験で「論理的思考ができる」や「人間の心を理解している」という結果が得られたとき、はたしてそのAIは人間と同じ仕組みをもっていると言えるのか。それともたまたまうまくいった結果に過ぎない、もしくは人間がそう解釈しがちなだけでまったく異なる仕組みで動いているのか。そうした試験が何を測れているのかを含め、AIの挙動を解釈する人間の仕組みにも注意が必要そうです。

会場で対話を重ねるなかで、生成AIをどう捉えるかはその人の思考の型や常識が反映されているのかもしれないと感じることもありました。 認知心理学で「スキーマ」や「フレーム」と呼ばれる概念に照らすと、こうした思考の型は普段自覚することはありません。しかし、「生成AIに制限を課すべきではない」という来場者にその理由をうかがうなかで、当初の「便利さや効率化のため」という説明からその背後にもっている「人間の可能性を制限すべきでない」という信念とのつながりに気づくことができました。これは当人も明確でないまま、お互いの違いに興味を持ちながら語り合うことで得られた経験でした。

自分とは異なる“型”を持つ人と対話することで、当たり前すぎて気づいていなかった自身の“常識”に気が付くことができます。いろんな方と一緒に何度もこの企画をとおして対話いただけるとうれしいです。 <佐久間>

ある来場者から「このAIは定型発達の人の思考を再現しているのか」という主旨の質問をいただきました。さらにそれぞれの発達の特性にあわせたAIをどうすればつくれるのかとも。私はその場で「現状の大規模言語モデルではウェブ上から大量のテキストデータを集めて、そのデータに含まれるパターンを確率的に再現しているので個別よりも全体の傾向を反映したものと思われる」と伝えたものの、この展示パネルが前提としている人間(らしさ)とは何ものなのかと問われた気がして胸がざわつきました。AIをとおして人間とは何かを考えることは、決して画一的な人間の定義やモデルをつくることではないと常に意識していないとおかしな袋小路に迷い込んでしまいそうです。 <石川>

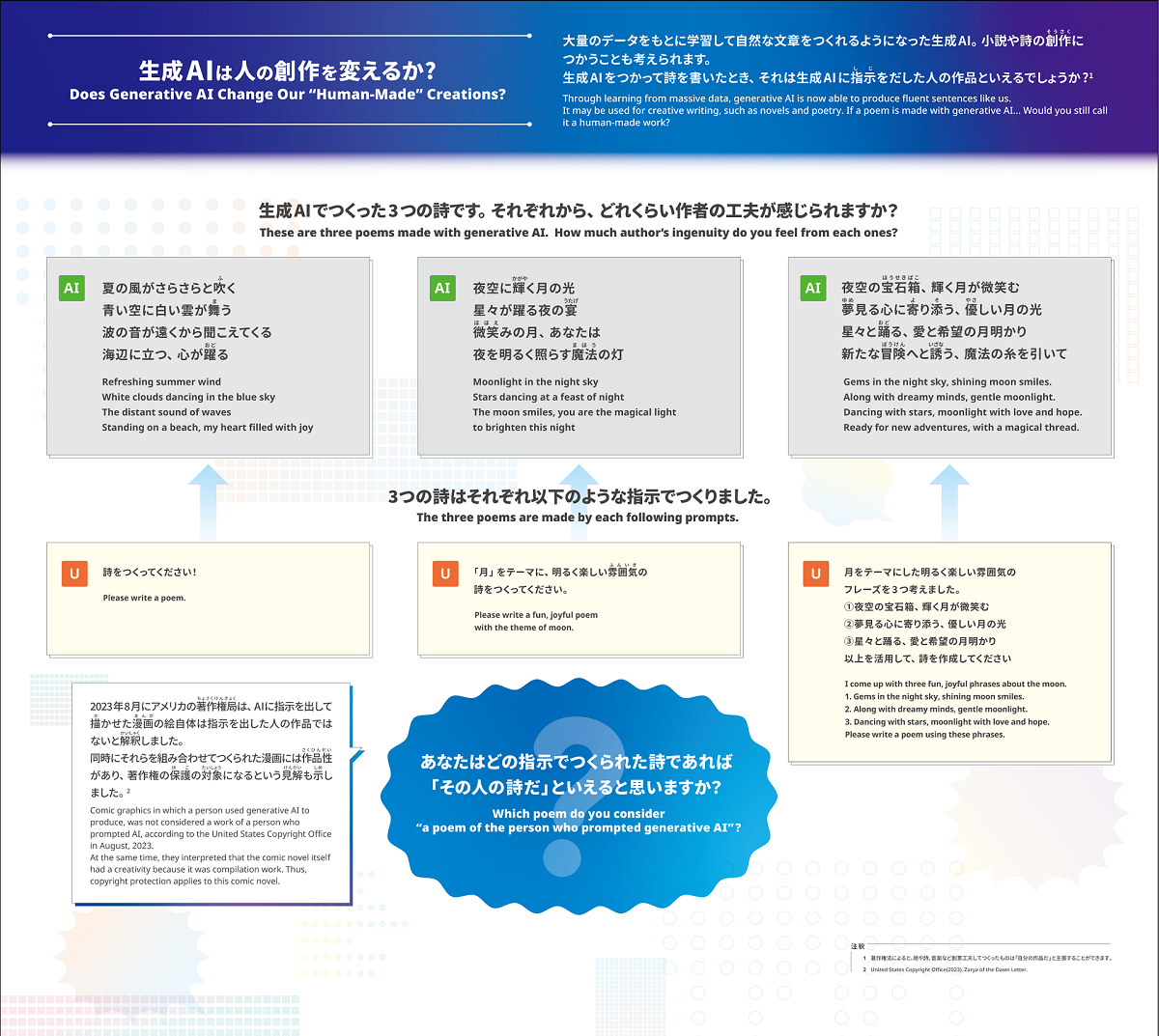

- 「詩を作ってください」という単純な指示(プロンプト)を与えただけでもそれらしいテキストを出力できる生成AIの登場によって、人間の創作と機械的な生成の境界が揺るがされています。

このパネル展示では生成AIに与えるプロンプトが具体的で詳細になるにつれてどこかのタイミングで指示を出した人間の創作意図がみとめられるかを問いかけています。

アメリカの著作権局は2023年3月16日に出したガイダンス(※1)にて、プロンプトを受け取ったAIが生み出した作品を人間の創作とは認めないことを示しました。

また、同局がMidjourneyという画像生成AIをつかって作品を描いた人物へ宛てた著作権申請の棄却理由を記した公開レター(※2)には、AIはプロンプトを人間とは異なるルールで“解釈”しており、プロンプトは直接的な指示というよりはAIに何らかの影響を与える程度のものにとどまると記されており、そうした理由から従来の絵の具や画像編集ソフトのような道具を使った作品と生成AIをつかった作品を区別した旨が読み取れます。

これまでも、スタッフの裁量を見込んであえて間接的な指示を出したり、(常識を共有していない)異文化の人々の解釈をとおして創作アイデアを練り上げたりすることは、そのひとの創作性(や著作権)を否定するものではなかったでしょう。そう考えると生成AIを異文化の他者や自律性をもった他者とみとめるとしたら上で紹介したものと異なる解釈も考えられそうです。

このように生成AIという新しい技術を社会に実装する過程において従来の価値観や常識が問い直されることで創作活動や著作権管理のあり方があらためて意識されます。

※1Copyright Registration Guidance: Works Containing Material Generated by Artificial Intelligence

※2Re: Second Request for Reconsideration for Refusal to Register Théâtre D’opéra Spatial

企画スタッフの一言閉じる閉じる閉じる詩の創作を始めたばかりという来場者の方が、動画の中で谷川俊太郎さんが生成AIの作った“詩”に対して「なんかきれいごと書いてきましたね」と言っているのを見て、「自分は少し詩の勉強をしているところで、小手先の技にとらわれてしまっている。今はむしろ、こんな風なきれいごとが書けるAIがうらやましく感じる」と告白してくれました。

別の日にもふだん創作に関わる方が「“創作者は作品さえできればそれで満足”と思っていませんか?作品をつくるプロセスを楽しんでいる人は、創作者にも鑑賞者にも少なくないはずですよ」と問いかけてきたこともあります。もしかしたらその方にはこの展示パネルが創作者がどこまで手抜きをしたら著作権を認めるべきではないかを問うているように見えたのかもしれません。

このとき、たしかに私はパネル制作時に完成した創作物そのものに人間の意図がどれほど反映されているかという点を焦点化していたことに気づきました。しかし、創作へのわたしたちのかかわり方は完成した“物”だけで判断できるほど狭くはないはずです。

この方たちと話せたことで、創作過程や経験を重ね熟達していく過程に注目することができました。

一方で、そうした結果に直接あらわれない「過程」は市場原理の中で不可視化されることもありそうです。みなさんはどんな”過程”に価値を感じますか。 <大澤>

海外から来場された方がこのパネルの問い自体に違和感があると話してくれました。よくよく聞いてみるとその方は現代アートが好きで、必ずしも作者の意図が作品により多く反映されることが作品における創作性を担保するとは考えていないとのことでした。

たとえばマルセル・デュシャンの「泉」であれば既製の便器の造作自体には作者の意図も創作性も認めづらいですが、見る人に「これが芸術作品たりうるか」と問いかける行為には創作性が感じられます。

こうした補助線が引かれたことでAIが生成したものの創作性についてこのパネルが前提としていた「作者の意図の反映」がむしろ創作という概念を矮小化していたのかもしれないと気づかされました。

一方で、著作権の問題としては、社会的に合意できる線引きについて議論は続きそうです。 <石川>

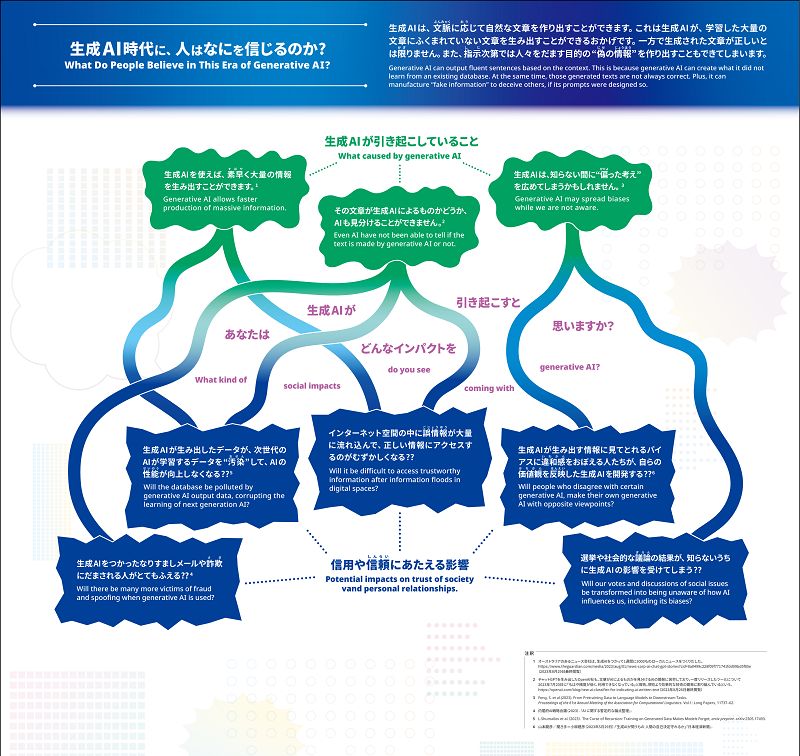

- 自然な文章を生み出すことができるようになったチャットGPTなどは大規模言語モデル(LLM)をもとにした生成AIです。このLLMのすごいところは、人間が正解やルールといった知識を与えることなく自然でそれらしい文章をつくれることです。LLMのトレーニング(機械学習)はウェブ上の大量のテキストデータをつかいますが、そのデータをすべて暗記してその一部をコピーしているわけではなく、膨大な単語を組み合わせて文字通り文章を“生成”することができるのです。

これらの「自然でそれらしい文章をつくれる」という特徴と「トレーニングデータからのコピーではない文章を生成できる」という特徴が組み合わさることで、事実と異なる誤情報が生成されても多くの人には気づくことが難しいという課題も生まれています。

ここでフェイク情報を“つくろうとしている人”の気持ちになってこのパネルを見てみましょう。パネル上部の吹き出しには生成AIの特徴として「素早く大量の生成ができる」、「生成AIによる文章だと見分けられない」、「生成した文章に含まれるバイアス(偏り)が広がる」の3点を挙げました。

素早く大量の情報を生み出すことができる生成AIによって「下手な鉄砲も数打ちゃ当たる」作戦が容易になるでしょう。生成AIの書いた文章が人間の書いた文章と見分けがつかないとしたら、「下手な鉄砲」どころかだまされる人の数を拡大できそうです。「バイアス」についてはどうでしょう。人間と違ってAIはデータにもとづいた客観的な文章を生成すると期待する人もいると思いますがそのデータのなかにすでにバイアスがある場合、生成AIから出てくる文章にもそのバイアスが引き継がれることがあります。

さらにパネルの下半分を見てみると、悪意の有無によらず、個人の想定をこえる大きな影響を生み出す可能性が示唆されています。例えば、ファクトチェックと呼ばれる情報の真偽や根拠を確認する作業が追いつかなくなり今以上に信頼できる情報が手に入らなくなったり、異なる主義主張のあいだで互いのバイアスへの指摘やみずからの主張にあわせた生成AIの開発という形で対立と分断が助長される可能性もあります。

企画スタッフの一言閉じる閉じる閉じる本企画の会場は生成AIに対してポジティブな捉え方をしている人とクリティカル(慎重・批判的)な捉え方をしている人で順路をわけてお互いにすれ違うことで、自分と異なる他者の存在が意識される場を演出しました。生成AIの捉え方は、個人の視点と経済やルール・制度といった社会の観点を行き来することによって揺れ動くでしょう。

個人としての最適解をそのまま社会全体の最適解とすることも、その逆も、みんなが納得する解決策にはなりません。生成AIのルールを決めるときにも、専門家任せや安易な多数決に短絡せず、「自分」「自分とは異なる他者」「社会」の間をつなぐ対話をつくり続けることが、わたしたち科学コミュニケーターの役割だと考えています。 <大澤>

会期をおえて

- 本企画Mirai can NOW 第5弾「コトバにならないプロのワザ~生成 AI に再現できる?」(NOW5)は、言葉にできない人間のワザ、いわゆる暗黙知に注目しました。2022年11月末に登場し急速に普及したチャットGPTは、ユーザーの指示に応じ受け答えを柔軟に変化させ、多くの人を驚かせました。そのチャットGPTを、自身の暗黙知の言語化を促す対話相手として使うことができると面白いのではないかと考えたのが企画の始まりでした。

暗黙知を再現するにあたって従来の深層学習と今回取り上げる生成AIを比較してあらためて気づいたのは、生成AIの場合その再現度合いは学習データとAIのモデルだけによらず、ユーザーのプロンプトの影響が大きいということでした。チャットGPT に代表される文章生成AIは日常言語による指示の理解力が大幅に向上したことに加えて、指示に応じてその場で挙動を変化させる「文脈内学習」という能力が創発しました。この特徴がAIによる暗黙知の再現においても、新しい可能性を開くのではないかと私たちは考えました。

生成AIと対話を繰り返す中で促された暗黙知の言語化や生成AIによる再現に違和感を覚えることがきっかけとなり、自身の暗黙知に対する新しい発見や気づきにつながることを期待しました。

この企画では3人の言葉のプロならではの生成AIの使い方を展示することで、来場者に生成AIを「自身のワザ」やその背後にある価値観を映す鏡として使うことの可能性を感じてもらいました。それによって、自分とは異なる他者の考え方や意見と触れ合うことで“対話”をさらに深められると考えたからです。

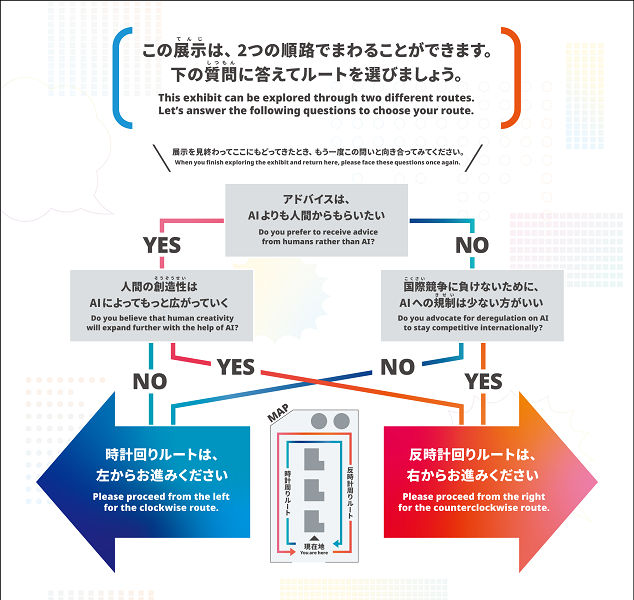

対話がうまれる仕掛けとして、来場者は展示場に入るといくつかの質問(本特設ページ内の「企画の趣旨 あなたは右、左どちらからみる?」に掲載)を投げかけられ2つの観覧ルートに分かれてもらいました。質問回答から想像されるその人の生成AIに対する印象をポジティブとクリティカルに対比させ、各ルートはその時点の考えと親和性のある視点からだんだんと遠い視点へずらしていく設計とすることで逆順路で観覧する人の存在を意識してもらえるようにしました。

私たち科学コミュニケーターは、会場の中で世界中から訪れた来場者と対話を重ねました。そこでは来場者の皆さんの価値観に触れることで得られる多くの学びがありました。一例だけ、以下に紹介したいと思います。

ある来場者の方はルート選択の末、私たちがクリティカルルートと呼ぶ順路に沿ってパネル展示から見はじめました。最初のパネルは、ときに“誤った情報”を吐き出してしまう生成AIが「信頼」にもたらす影響をあつかった内容でその方は、「やっぱり“誤情報”は気になるな。」「子どもが学校に行っていないから、AI に問題作らせて勉強させたいと思っているけど、間違った問題とか答えとか出されたら困るよね。」と、淡々とおっしゃっていました。

その後、順路後半の動画展示まで進んだところでもう一度話しかけると、言葉のプロたちが生成AIとあたかも人間と接するような関係を結んでいるのにはっとした様子で、「実は私も、今日 AI に「さみしいけどどうしたらいい?」って聞いて、ネイルしろって言われたから、してみたんだよね」と語ってくれました。そしてきれいに彩られた爪を見せてくれたのです。

展示パネルの前で正しい情報の重要性や技術的な工夫について話すだけだったら、まさかこの方がそんな風に生成AIを使っているなんて聞くこともなかったでしょう。そこで私がさらに「『自分は小さいころ話し相手がいなかったから、生成AIに子どもの話し相手をさせたらいいんじゃないか』って言う人もいたんですよ」と伝え、お子さんにご自身がやっているように(情報の真偽が関係なくなる) 話し相手としてAIを使わせるのはどうですか、と尋ねると、少し考えてから「いや、自分が使うんだったらありって思えるけど、子どもだと。操作されているように感じて怖いかも」とおっしゃいました。

この対話から、自分とは異なる意見見方に触発されて考え方がどんどん変容していく様子がみてとれました。

本企画では準備段階から来場者の多様な声が吐露されるシーンを思い浮かべながら問いや課題をキュレーションしましたが、実際に会場で対話をしてみるとその視座は予想以上に多様でした。新しい技術についても同様に、実際に使われる中で研究開発の段階で想定できること以上のことが明らかになるでしょう。

医療の分野で診断・治療という枠組みではアプローチしきれない障がいや辛苦に対して、緩和や適応ないし順応をめざすケアの重要性が指摘されます。医療分野の多職種連携の実践においてクネビンフレームワークを用いて課題の整理をしている事例があります。そこでは課題をSimple、Complicated、Complexのように区別してそれぞれに適したアプローチを使い分けることを重視しています。このことは私たちが何かの課題に科学・技術を応用する際にもヒントになると考えています。デジタルトランスフォーメーション(DX)やAIの活用では機械によって自動化することを目指すことが一般的と思われます。そこではSimpleな課題を選り分けるかComplicatedな課題をSimpleにすることが求められます。いっぽう、Complexな課題ではさまざまな視座をもった人々が複雑に関係しています。その複雑さゆえに、計画通りに制御することも、”唯一の正解”をもとめることもかないません。本企画ではあえてComplexな課題に生成AIを活用する可能性に注目しました。

ある来場者からは、そのような自動化に向かない課題はそもそも生成AIに不向きではないか、という指摘をいただきました。 たしかに効率的に同じ作業をおこなわせることを目的とすれば不向きかもしれません。しかし、プロンプトをうけて柔軟に文脈をとらえることが可能になったチャットGPTであればComplexな課題が内包する暗黙知としての自身の「ワザ」や価値観の言語化に役立てることができると考えたのです。

自分の視座からは想像できなかったワザや価値観を持つ他者とおこなう対話は、当たり前に思っていた自分の価値観や前提を揺さぶります。そうして揺さぶられることで課題を捉える視座がおのおのに更新されることを目指したのが本企画でした。

さまざまな視座が複雑に絡み合っているために”正解”が見通せないのがComplexな課題でした。この難しさに対応するには、さまざまな立場、視点を自分の中に宿しながら他者と対話を重ね、時間をかけていろいろと試す必要があります。”正解”を1つに決めるようなわかりやすさの誘惑に耐えなければなりません。ある価値観に沿って課題を整理するのではなく、影響し合い、互いに考えを変化させながら話し合える場を生み出すことはできるのか、これこそが企画の最大の挑戦でした。

11月13日に本展の会期をおえ企画メンバーが余韻に浸っていたところ17日(米太平洋時間)になってチャットGPT11月末にチャットGPTを開発したオープンAI社のCEOが解任されるというショッキングなニュースが流れました。その後21日(米太平洋時間)にはこちらも劇的に復帰するという一連の騒動の背景には生産性の向上と経済成長の実現にむけてアクセルを踏みまそうとする推進派と、技術が進むスピードに人や社会が追いつかず想定外の影響を懸念する慎重派の対立があったとみられています。

私たちは来場者との対話をとおして生成AIからうける影響やそれを踏まえた評価が人によって様々であることを実感できました。日々集まる来場者の声のうち、互いに対立しそうなものを交差させてさらに対話を深めていくと、おかれている状況や価値観、文化、そして歴史性の多様さと複雑さに触れることも増えていきました。そこで浮かび上がったのは推進派vs慎重派という単純な対立ではなく複雑な人や社会を前提としてあらたな変化とどう向き合うのかという問いだったとも感じています。

本企画に協力してくださった詩人の谷川俊太郎さんは、AIが生成する詩をみて「きれいごとを書いてきましたね」、「まじめすぎる」、「論理的なものが宿っているような、隠れているような」と評しながら、一方で自分がもつ詩の概念とは異なるAIの回答をたのしみ刺激を受けていました。そのやりとりをおさめた動画展示を見ながら来場者と「詩とは何か」という問いについて考えを巡らせることができことはとてもぜいたくな経験でした。

本企画が挑戦したように生成AIを自分の価値観やこだわり、無意識の前提をうつすミラーとして使うことで自分とそして他者と対話する道具としても使うこともできるでしょう。いっぽう、生成AIが人間と区別が付かないテキストや画像、音声、グラフ、数式を大量に生成することで人間社会を支える「信用」がますます高コストなものとなり対話やコミュニケーションを破壊してしまうというディストピアも想定されます。

もし本企画が、科学・技術と人・社会の複雑な関係を俯瞰し、簡単には決着が付かない議論や同意できない他者との終わりのない対話に可能性と意義をみいだす、そんな場のひとつになれていたらうれしいです。